Una nuova generazione di artisti, designer ed architetti sta utilizzando la Generative AI come strumento di espressione creativa; inoltre, la diffusione di software come Stable Diffusion, Midjourney e DALL-E, basati su modelli quali Diffusion Models e Transformers, ha reso accessibili al grande pubblico queste tecnologie. In TIM stiamo esplorando le tecniche di generazione tramite AI di contenuti multimediali per il metaverso; strumenti chiave sono:

- prompt engineering: creazione di una descrizione testuale funzionale ad ottenere al meglio il contenuto desiderato;

- creazione di un pattern/contenuto iniziale che guiderà il modello di AI nella generazione dei risultati;

- fine tuning: riaddestramento parziale dei modelli di generative AI allo scopo di personalizzarli su contesti specifici;

- selezione: scelta, tra i molti risultati ottenibili, di quelli che soddisfano al meglio i criteri funzionali ed estetici di interesse.

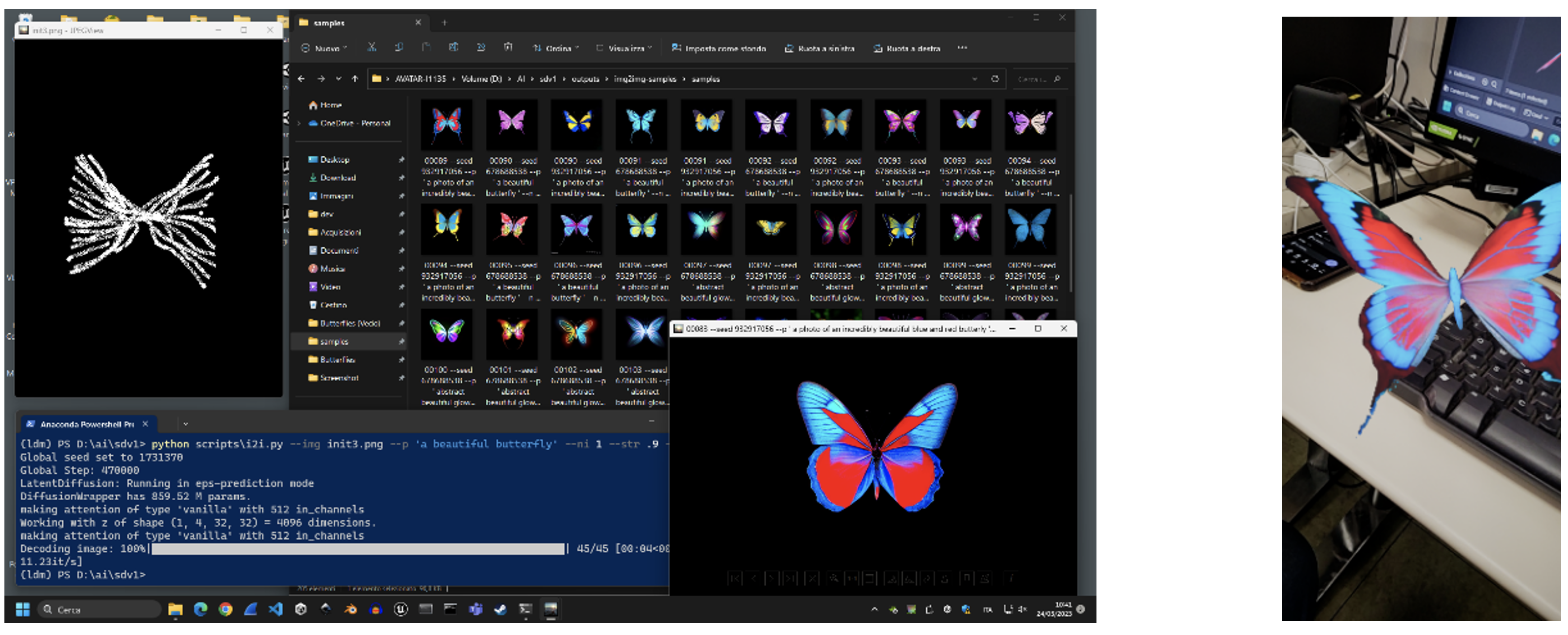

In TIM è stata creata un’installazione artistica interattiva in Augmented Reality, chiamata “Butterflies”, come Proof of Concept del processo creativo e tecnologico mirante alla fusione tra Generative AI ed esperienze nel Metaverso. La realizzazione si è articolata in:

- generazione di forme e disegni delle ali di farfalle virtuali, tramite prompt engineering, impostazione di un pattern visivo iniziale e selezione guidata da criteri estetici. Come software di Genertive AI è stato utilizzato Stable Diffusion;

- trasformazione dell’immagine delle farfalle generate in oggetti 3D, tramite algoritmi di visione artificiale ed applicazione del software di modellazione Blender;

- animazione del battito delle ali e simulazione del volo delle farfalle, tramite Blender e l’XR engine Unr eal Engine 5 (UE5);

- sviluppo in UE5 di un’app in Augmented Reality che permette di creare farfalle virtuali nel Metaverso, osservarne forme, disegno e volo, ed in teragire con esse.