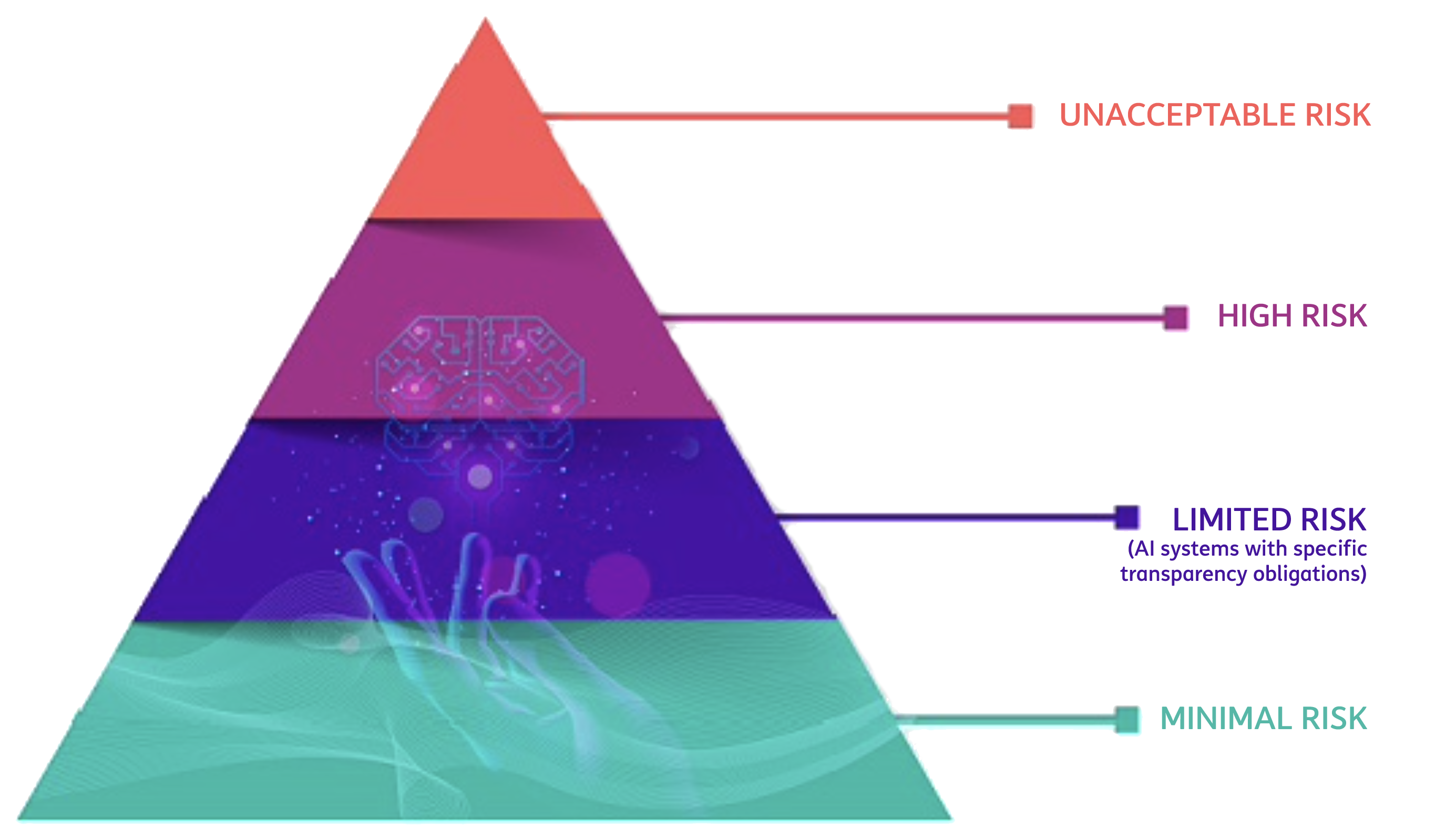

L’utilizzo dei sistemi di Intelligenza Artificiale nell’UE sarà regolamentato dall’AI Act, norma che affronta i rischi dell’IA e mira ad un ruolo di primo piano dell’Europa a livello globale sull’argomento. Come già anticipato dal Libro Bianco sull’Intelligenza Artificiale nel 2020 [5], l’intento della Commissione è di consentire uno sviluppo affidabile e sicuro dell’Intelligenza Artificiale in Europa, nel pieno rispetto dei valori e dei diritti dei cittadini dell’UE. La Commissione Europea si prefigge quindi l’ambizioso obiettivo di trovare un giusto equilibrio tra il bisogno di regolamentare il rapido sviluppo della tecnologia, soprattutto in termini di impatto e conseguenze sulla vita dei cittadini, e la necessità di non frenare l’innovazione. L’AI Act, un regolamento orizzontale (non settoriale), direttamente applicabile negli Stati membri senza bisogno di essere recepito nelle normative nazionali, detta le regole per lo sviluppo, l’immissione sul mercato e l’utilizzo di sistemi di Intelligenza Artificiale nell’Unione europea, adottando un approccio basato sul rischio. Sono inoltre stabilite misure per favorire l’innovazione, come ad esempio la creazione di spazi di sperimentazione normativa (sand boxes) o alcune agevolazioni per startup e PMI. L’AI Act definisce quattro categorie di sistemi di Intelligenza Artificiale, sulla base della finalità di utilizzo dell’applicazione di IA e dell’entità del potenziale danno e della sua probabilità, le quali saranno sottoposte a regimi differenti a seconda del rischio che presentano: rischio inaccettabile, rischio elevato, rischio limitato e rischio minimo (come mostrato in Fig. A).

Figura A: Livelli di rischio definiti nell’AI Act – fonte della figura: webpage della Commissione Europea Regulatory framework proposal on artificial intelligence | Shaping Europe’s digital future (europa.eu)

Saranno banditi i sistemi di IA che potrebbero essere utilizzati in modo intrusivo e discriminatorio, con rischi inaccettabili per i diritti fondamentali dei cittadini, la loro salute, la loro sicurezza o altre questioni di interesse pubblico, come ad esempio il riconoscimento facciale e l’identificazione biometrica, la manipolazione comportamentale, la polizia predittiva, il riconoscimento delle emozioni. Le applicazioni considerate ad alto rischio saranno consentite subordinatamente al rispetto di determinati requisiti obbligatori (ad es. sistema di gestione del rischio, robustezza, trasparenza, controllo umano, etc.) e ad una valutazione di conformità ex ante e sono oggetto principale delle norme del regolamento. La proposta di AI Act definisce le aree in cui ci sarà una presunzione di rischio elevato, mentre la puntuale identificazione dei sistemi ad alto rischio è ancora oggetto di intenso dibattito tra le istituzioni. Le applicazioni a rischio limitato saranno consentite ma sono soggette ad obblighi di trasparenza, mentre per le applicazioni a rischio minimo non è previsto alcun obbligo ex ante, anche se la Commissione incentiva l’adozione di codici di condotta per l’applicazione volontaria dei requisiti fissati per i sistemi di IA ad alto rischio. Più recentemente, il dibattito si è concentrato sui cosiddetti General Purpose AI ed in particolare sull’AI generativa (es. ChatGPT), che secondo le istituzioni meritano delle regole ad hoc, tuttora in discussione. Il percorso legislativo è iniziato ad aprile 2021 con la proposta della Commissione, seguita poi dalla posizione del Consiglio del dicembre 2022 e da quella del Parlamento di giugno 2023. I negoziati tra le istituzioni europee (cosiddetti triloghi) sono attualmente in corso e sono diversi i punti del testo ancora da definire. Si prevede che il regolamento possa essere approvato tra la f ine del 2023 ed i primi mesi del 2024. Le nuove norme saranno applicabili dopo 24/36 mesi dall’entrata in vigore del regolamento. Poiché la normativa potrebbe non essere applicabile prima del 2027, il Commissario per il Mercato interno Breton spinge le aziende del settore dell’IA ad impegnarsi alla compliance anticipata, con l’adesione volontaria ad un AI Pact, ad oggi in fase di definizione.